Si no frenamos la carrera armamentística para desarrollar "robots asesinos", los resultados serán "catastróficos" para la humanidad.

Esa es la advertencia de la ONG Pax, organización dedicada a la defensa de la paz con sede en Holanda, sobre los avances en inteligencia artificial para uso militar por parte de grandes potencias mundiales como China o Estados Unidos, y en el marco de la falta de normas internacionales al respecto.

"Nos situamos frente a un futuro cercano en el que armas de inteligencia artificial se apoderarán de puestos que hoy ejercemos los humanos, seleccionado y atacando objetivos por sí mismos", señaló esta semana en un comunicado Daan Kayser, líder del proyecto en armamento autónomo de Pax.

"Sin normas internacionales claras, podemos entrar en una era en la que algoritmos, no personas, decidirán sobre la vida y la muerte", enfatiza.

- ATLAS, el controvertido programa con el que Estados Unidos quiere dotar de inteligencia artificial a sus tanques

- Por qué Estados Unidos está perdiendo su superioridad militar frente a Rusia o China

La advertencia de este grupo se suma a otros llamados similares en años recientes desde distintos sectores.

Más de 100 líderes en robótica urgieron en 2017 a la ONU a que tomara cartas en el asunto para prevenir el desarrollo de los llamados "robots asesinos".

En una misiva a la organización, líderes en este campo, incluido el multimillonario Elon Musk, advirtieron sobre lo que llamaron "la tercera revolución" en armas de guerra.

Sus defensores, no obstante, destacan la efectividad que podría tener este tipo de armamento y sus ventajas a la hora de evitar errores.

Estados Unidos, líder

La organización destaca los avances realizados por siete países que buscan convertirse en líder en inteligencia artificial y que más han invertido en sus aplicaciones militares: Estados Unidos, China, Rusia, Reino Unido, Francia, Israel y Corea del Sur.

Sobre Estados Unidos, que se considera líder en el sector seguido de cerca por China, el Pentágono anunció en 2018 la mayor inversión hasta la fecha en sistemas de inteligencia artificial para armamento: 2 mil millones de dólares para desarrollar la siguiente "oleada" de esta tecnología.

Qué es un "robot asesino"

- El llamado "robot asesino" es un arma completamente autónoma que puede seleccionar y atacar objetivos sin la participación significativa del humano. De momento, no existen pero los avances en el sector acercan la posibilidad de que se conviertan en una realidad, destaca Pax.

- Sus defensores creen que las actuales normas sobre conflictos pueden ser suficientes para gestionar cualquier problema surgido del uso de estos "robots asesinos" en combate. Pero si se considerada que la regulación existente es insuficiente, favorecen una moratoria en su uso pero no una prohibición.

- Quienes se oponen consideran que son una amenaza para la humanidad y que debería prohibirse que se les otorgara cualquier capacidad para matar de forma autónoma.

Estados Unidos también está trabajando en proyectos como ATLAS (Advanced Targeting and Lethality Automated System), que busca proporcionar inteligencia artificial a los tanques para "identificar y atacar objetivos al menos el triple de rápido que con el actual proceso manual", según la web del Ejército estadounidense.

El programa generó controversia por el poder que se le podría dar a la máquina y el Ejército estadounidense ha tratado de calmar los ánimos asegurando que los humanos siempre tendrán la decisión final sobre el ataque.

China también está priorizando la inversión en inteligencia artificial como una pieza fundamental de su poder militar y nacional, destaca la ONG.

En 2017, Pekín presentó un plan para convertirse en el líder mundial en inteligencia artificial, con el objetivo de crear una industria valorada en 150 mil millones para 2030.

El gobierno chino ha creado dos organizaciones de investigación centradas en este ámbito. Artículos de miembros del Ejército chino sugieren que Pekín está desarrollando un algoritmo que puede ayudar a predecir qué ocurrirá en el campo de batalla, publicó uno de los pocos diarios parcialmente independientes de China, The South China Morning Post, este mes.

El año pasado, indica Pax, desde algunos sectores del gobierno se pidió al Ejecutivo evitar una carrera armamentística sobre inteligencia artificial, si bien el liderazgo chino "continúa aspirando al uso de inteligencia artificial para fines militares".

El informe también muestra que en todos los países analizados, la cooperación con el sector privado es crucial para los proyectos militares en inteligencia artificial y, mientras algunas empresas tienen una postura clara contra las armas autónomas, otras no se muestran tan reacias.

Controles

En este contexto, desde Pax se urge a la comunidad internacional a trabajar en normas "claras" que regulen el uso de este tipo de armamento.

Ante la ONU, Estados Unidos destacó en 2018 la necesidad de "un entendimiento compartido de los riesgos y beneficios" de este tipo de tecnologías antes de decidir sobre una política en concreto y consideró "prematuro" negociar sobre ello en la actualidad ante la falta del mismo.

EU es uno de los países que posee una política específica sobre sistemas de armamento autónomo diseñada para reducir el riesgo de que los "robots asesinos" vayan a atacar al objetivo equivocado.

China, por su parte, se ha mostrado a favor de una prohibición de su uso pero no sobre el desarrollo de este armamento, lo que generó dudas sobre su postura, señala Pax.

"Una carrera armamentística en inteligencia artificial es comúnmente definida como un juego en el que ganan todos, pero es más probable que sea una situación en la que no haya ganadores (...). Será desestabilizador y aumentará las probabilidades de un conflicto. Tendrá un impacto económico, político y en la sociedad negativo", destaca el informe.

Otros expertos también muestran su preocupación por el uso que se puede dar a estas armas y por la posibilidad de que sean usadas contra civiles.

"El problema es que las computadoras no son capaces de determinar cuándo es legal o moralmente aceptable quitar una vida, y no pueden exigirles responsabilidad moral o legal por hacerlo", manifestó el profesor Peter Asaro, vicepresidente del Comité Internacional para el Control de las Armas Robóticas, a la BBC.

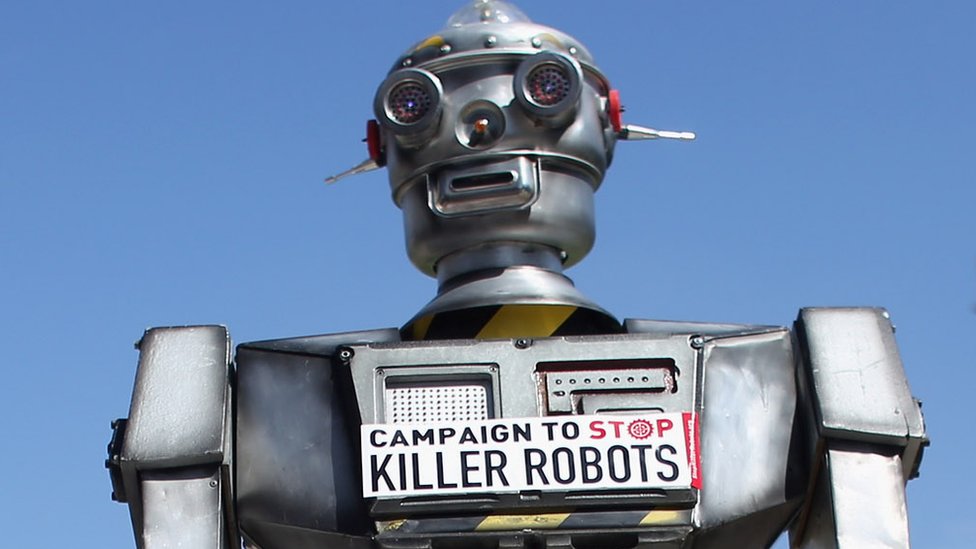

Unas 90 organizaciones no gubernamentales de 50 países se unieron para crear la Campaña para Detener a Robots Asesinos (Campaign to Stop Killer Robots), e impulsan la creación de un tratado internacional al respecto.

Ahora puedes recibir notificaciones de BBC News Mundo. Descarga nuestra app y actívalas para no perderte nuestro mejor contenido.